A Survey on Deep Hashing Methods 深度散列方法综述

Motivation:

深度哈希是近几年来的热方向,大家都将传统的哈希方法往深度学习方向引入,以获取更好的end2end哈希表示。

Contribution:

本文对深度哈希的综述,方便对这个方向感兴趣的同学进行了解。

- 深度监督哈希主要分为5类:

①成对相似保留(pairwise similarity preserving),Loss衡量每对之间的相似性;

②多对相似保留(multiwise similarity preserving),Loss衡量多数据点之间的相似性;

③隐式形似保留(implicit similarity preserving),Loss不直接使用数据点之间的相似性,但是用了类似于互信息之类的信息;

④量化(quantization);

⑤面向分类的深度哈希(classification oriented),Loss更多体现类别信息;

"we also categorizes the deep hashing algorithms according to the similarity preserving manners into: pairwise similarity preserving, multiwise similarity preserving, implicit similarity preserving, quantization and classification oriented."

- 深度监督哈希主要考虑4个问题:

①网络结构的使用;

②相似性与类别信息的使用;

③离散化问题解决;

④还有什么方法能继续改进;

- 作者认为深度哈希不能通过网络结构来分类;

- 成对相似保留(pairwise similarity preserving)

通过约束成对之间的相似度来优化;

主要是3个方向:

①Product loss minimization;(乘积计算loss)

②Difference loss minimization;(差积计算loss)

③Likelihood loss minimization;(根据概率模型计算loss)

- 多对相似保留(multiwise similarity preserving)

"this kind of loss tries to preserve the similarity orders for more than two items that computed in input space and Hamming space. It should be pointed out that triplet loss is the most popular loss among them for its simpleness."

主要是三元组loss;

①Deep Neural Network Hashing;

②Deep Regularized Similarity Comparison Hashing;

等等;

- 隐式形似保留(implicit similarity preserving)

隐式的利用相似性信息;

①Hashing with Mutual Information;

②Hashing as Tie-Aware Learning to Rank;

等等;

- 量化(quantization)

①Deep Quantization Network;

②Deep Triplet Quantization;

③Deep Visual-semantic Quantization;

等等;

- 面向分类的深度哈希(classification oriented)

主要是transfer learning and feature extraction;

①Deep Binary Hashing;

②Supervised Semantics-preserving Deep Hashing;

等等;

- 深度哈希的新方向

①使用GAN进行深度哈希学习;(HashGAN)

②使用集成学习进行深度哈希;(多个deep hash模型进行emsemble)

③一些在训练策略方向上的改进;(Greedy Hash,Gradient Attention Network)

④深度无监督哈希方法;(主要分为三类:去除相似性的深度哈希,深度哈希生成模型,无监督转有监督)

⑤多模态深度哈希方法;(文本、音频、视频)

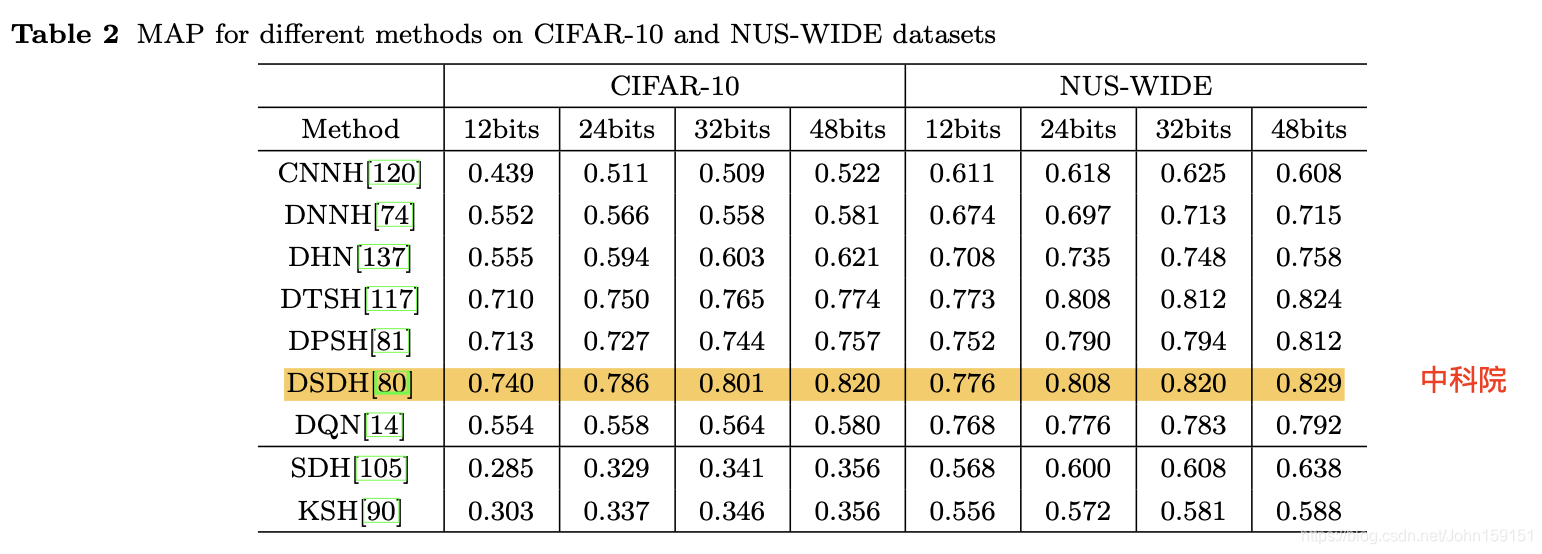

- 通过目前深度哈希方法的实验效果对比,可以得出下面的结论:

①深度哈希方法效果优于传统方法;

②在深度哈希中相似性信息是必需的;

③使用分类标签信息可以提升深度哈希方法的效果;

④一些策略可以提升深度哈希模型效果和鲁棒性,包括正则化,集成学习,bit balance,bit independence;